原理:

TensorFlow使用的求導方法稱為自動微分(Automatic Differentiation),它既不是符號求導也不是數值求導,而類似于將兩者結合的產物。

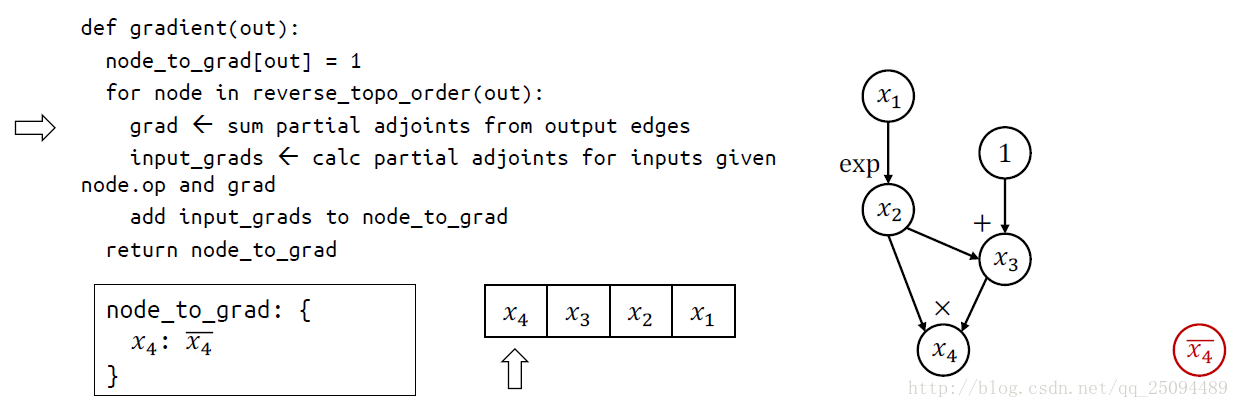

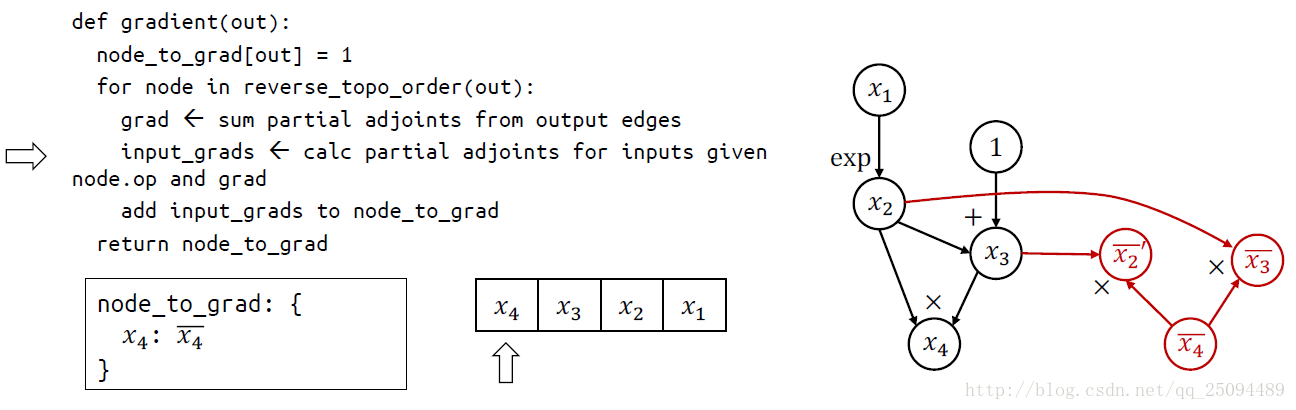

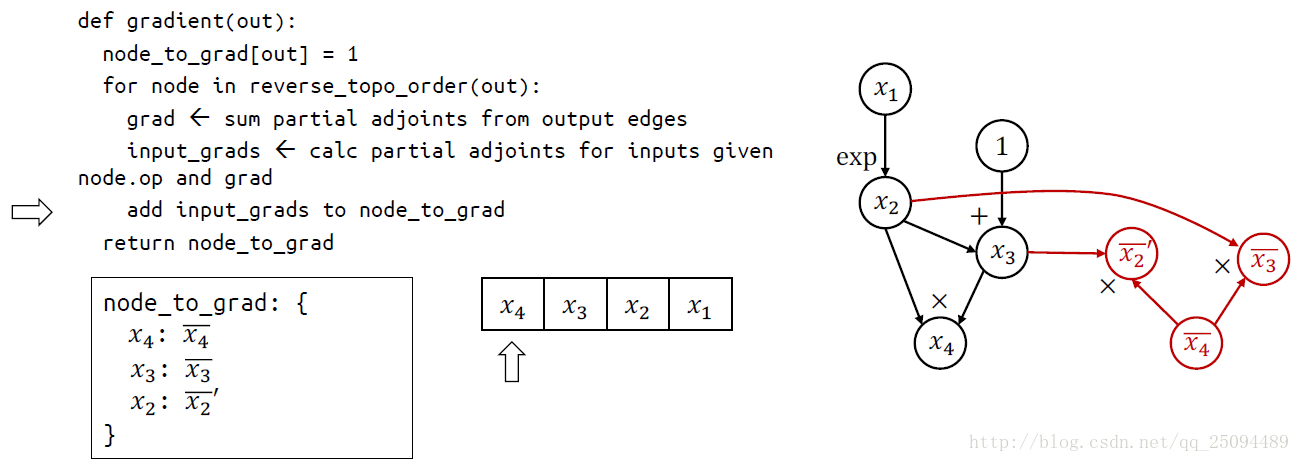

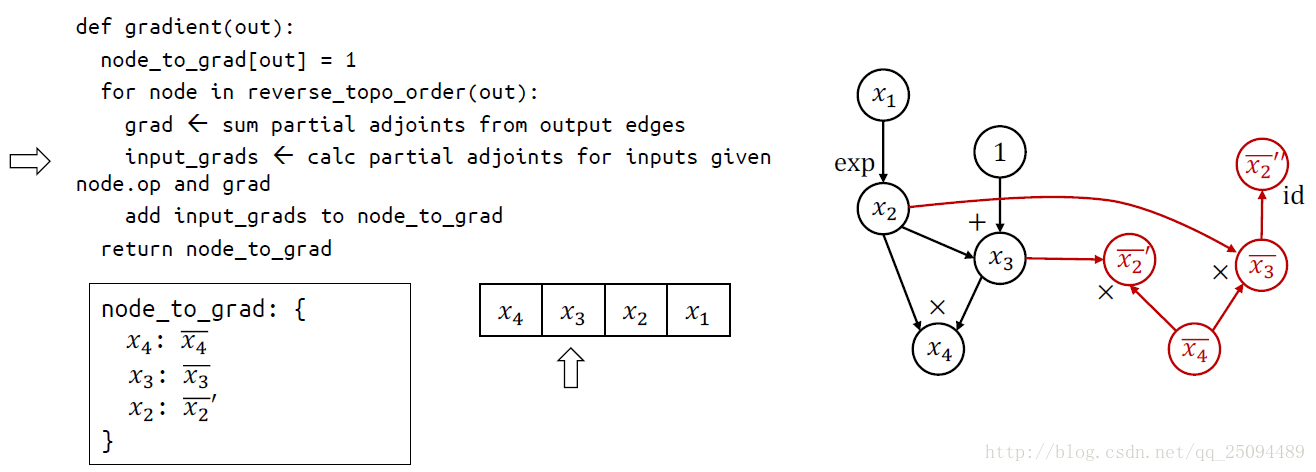

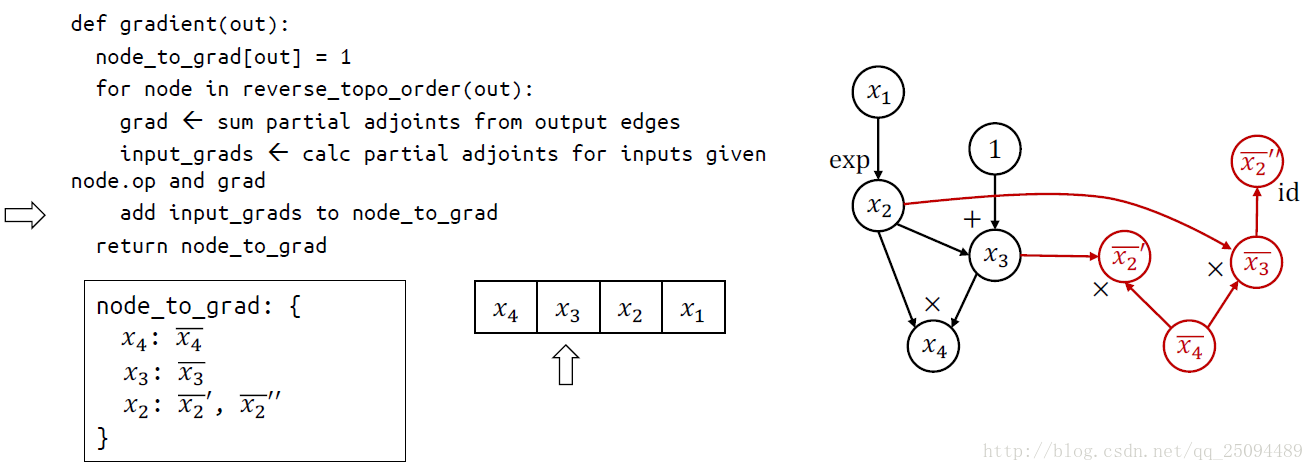

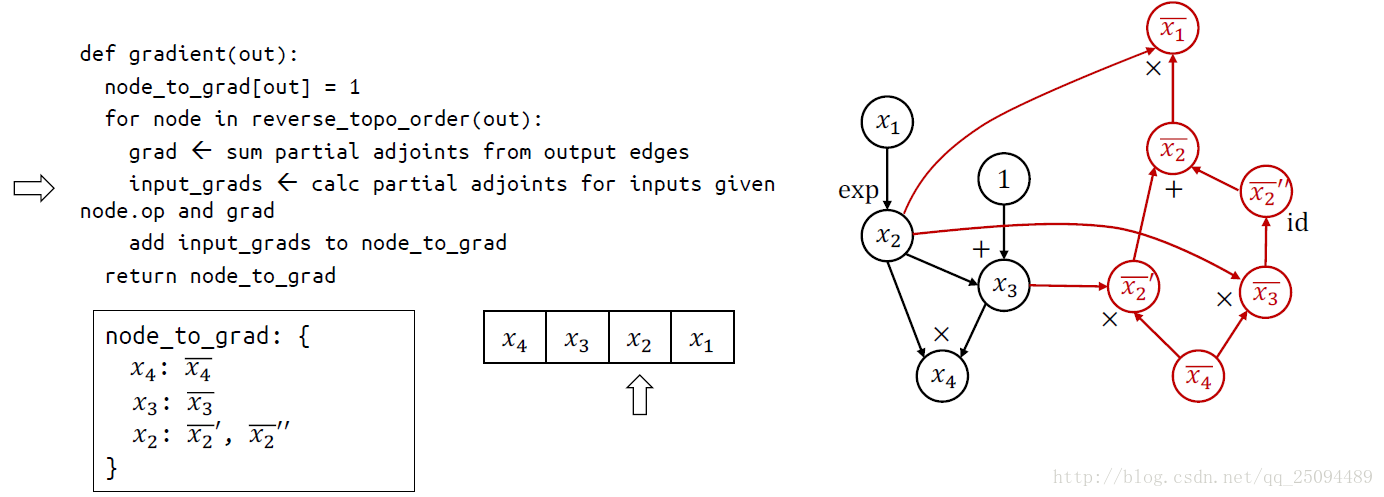

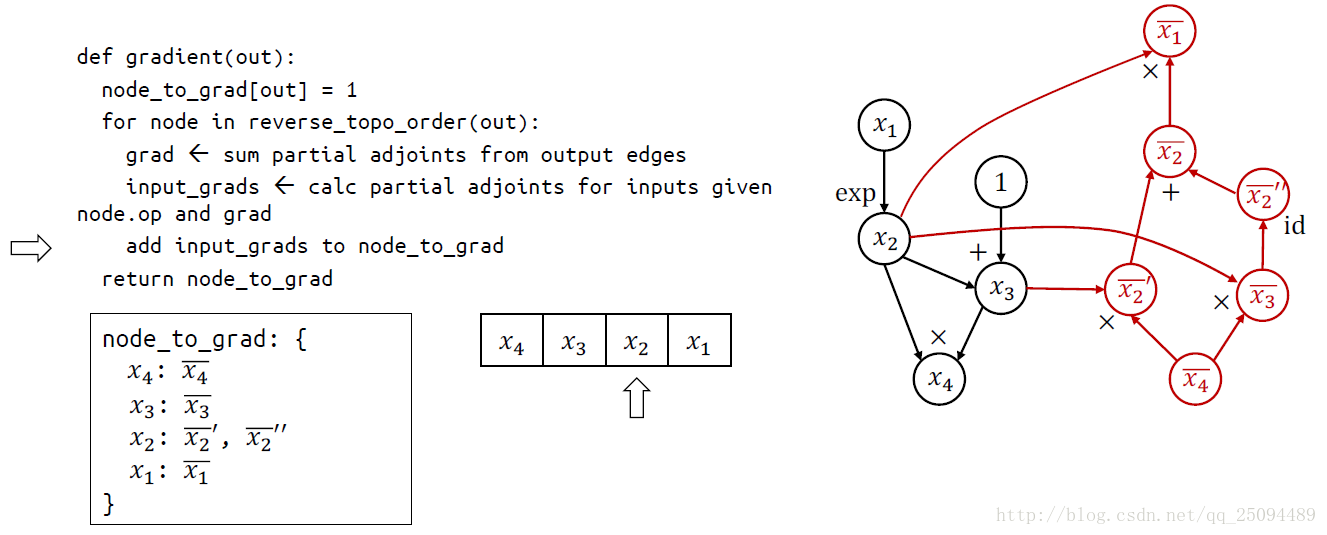

最基本的原理就是鏈式法則,關鍵思想是在基本操作(op)的水平上應用符號求導,并保持中間結果(grad)。

基本操作的符號求導定義在\tensorflow\python\ops\math_grad.py文件中,這個文件中的所有函數都用RegisterGradient裝飾器包裝了起來,這些函數都接受兩個參數op和grad,參數op是操作,第二個參數是grad是之前的梯度。

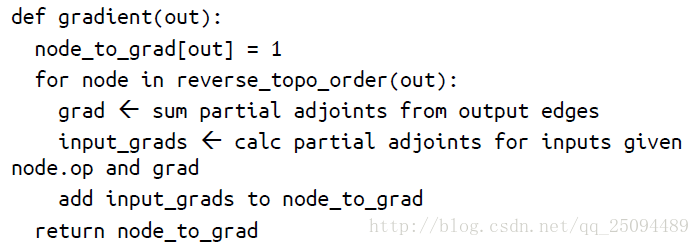

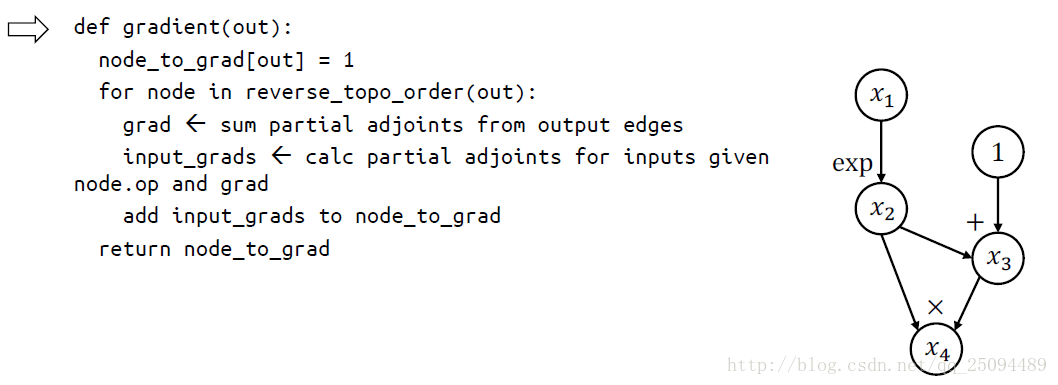

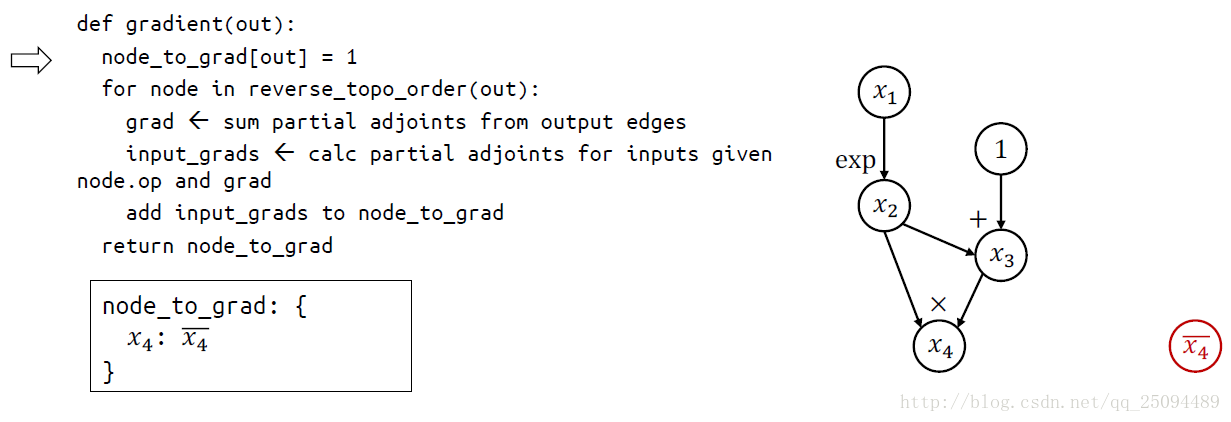

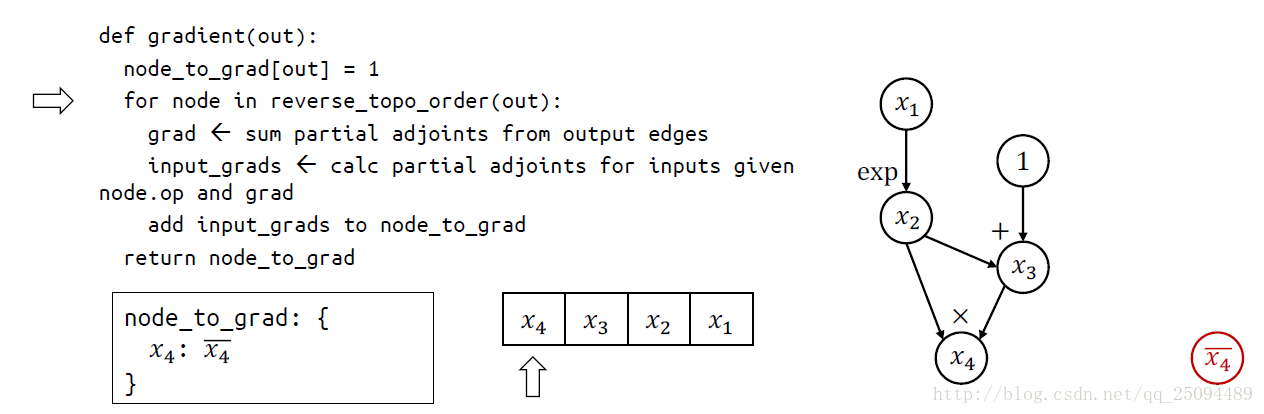

鏈式求導代碼:

舉個例子:

補充:聊聊Tensorflow自動求導機制

自動求導機制

在即時執行模式下,Tensorflow引入tf.GradientTape()這個“求導記錄器”來實現自動求導。

計算函數y(x)=x^2在x = 3時的導數:

import tensorflow as tf

#定義變量

x = tf.Variable(initial_value = 3.)

#在tf.GradientTape()的上下文內,所有計算步驟都會被記錄以用于求導

with tf.GradientTape() as tape:

#y = x^2

y = tf.square(x)

#計算y關于x的導數(斜率,梯度)

y_grad = tape.gradient(y,x)

print([y,y_grad])

輸出:

[tf.Tensor: shape=(), dtype=float32, numpy=9.0>, tf.Tensor: shape=(), dtype=float32, numpy=6.0>]

以上為個人經驗,希望能給大家一個參考,也希望大家多多支持腳本之家。

您可能感興趣的文章:- 使用tensorflow 實現反向傳播求導

- tensorflow中的梯度求解及梯度裁剪操作

- Tensorflow 如何從checkpoint文件中加載變量名和變量值

- Python3安裝tensorflow及配置過程

- 解決tensorflow 與keras 混用之坑

- tensorflow中的數據類型dtype用法說明